벌써 2026년의 4분의 1이 지나갔습니다. 26년 1분기에는 베트남 하노이에서 학회 참가 및 발표도 하였고 세 번의 시험 끝에 RHCSA 자격증을 취득했습니다. 그리고 연구 방향을 Serverless Computing에서 On-Device AI 시스템 쪽으로 전환했습니다.

[26.01] ICOIN 2026 학회 참가 및 발표 at 베트남

연구실 구성원들과 함께 ICOIN 2026(International Conference on Information Networking) 학회 참석을 위해 2026년 1월 초에 베트남 하노이로 갔습니다.

정확히 7년 전인 2019년 1월, 배낭 하나 메고 남자 6명이서 떠났던 동남아 일주(싱가포르 → 말레이시아 → 태국 → 라오스 → 베트남)의 마지막 여행지가 바로 베트남 하노이였습니다. 당시 기계공학을 전공하던 20대 초반의 제가, 7년 뒤 전공을 완전히 바꿔 컴퓨터공학 대학원생이 되어 하노이에 학회 발표를 하러 오게 될 줄은 전혀 상상하지 못했습니다. 시간이 참 빠르다는 생각과 함께, 매 순간을 더 밀도 있게 살아가야겠다는 다짐을 하게 되었습니다.

학회에서의 영어 발표는 잘 마무리했습니다. 작년 여름 PlatCon 때보다는 확실히 여유가 생겼지만, 여전히 제 생각을 자유롭고 유창하게 표현하는 역량은 부족하다고 느꼈습니다. 연구가 끝이 없듯, 영어 또한 꾸준히 갈고닦아야 할 부분임을 다시 한 번 깨달았습니다.

[26.02-03] RHCSA 자격증 세 번만에 취득 🪪

올해 목표 중 하나였던 RHCSA(Red Hat Certified System Administrator) 자격증을 취득했습니다. RHCSA는 Red Hat에서 주관하는 리눅스 시스템 관리자 자격증이며, 객관식 문제나 단답형, 주관식은 없고 100% 실기 시험입니다.

2월에 일주일 정도 학원을 다니면서 본격적인 자격증 취득 준비를 시작했고, 3월 초에 첫 시험을 봤지만 대학원 업무와 병행하다 보니 절대적인 공부량이 부족하여 불합격했습니다. 곧바로 재시험을 신청했지만, 두 번째 시험에서는 잘 풀었음에도 시험 환경의 네트워크 설정 문제를 이상하게 푸는 바람에 일부 문항의 채점이 정상적으로 이루어지지 않아 또 한 번 불합격했습니다.

두 번째 시험 응시 비용까지는 연구실에서 지원을 해 주었는데, 세 번째 시험부터는 비용을 직접 부담해야 했으며, 얼른 자격증을 취득하고 연구에 온전히 집중하고 싶었습니다. 그래서 세 번째 시험을 보러 갈 때는 정말 많이 긴장됐지만 다행히 합격을 하게 되었습니다.

한 번에 합격하지 못한 아쉬움보다는 “포기하지 않고 끝까지 마무리했다”는 뿌듯함이 더 컸습니다. 자세한 합격 후기는 블로그에 정리해 두었으니, RHCSA 자격증에 관심이 있거나 준비하시는 분들께 작은 도움이 되었으면 합니다.

[26.02-03] 연구 방향 전환: Cloud 시스템 ⇒ On-Device AI 시스템

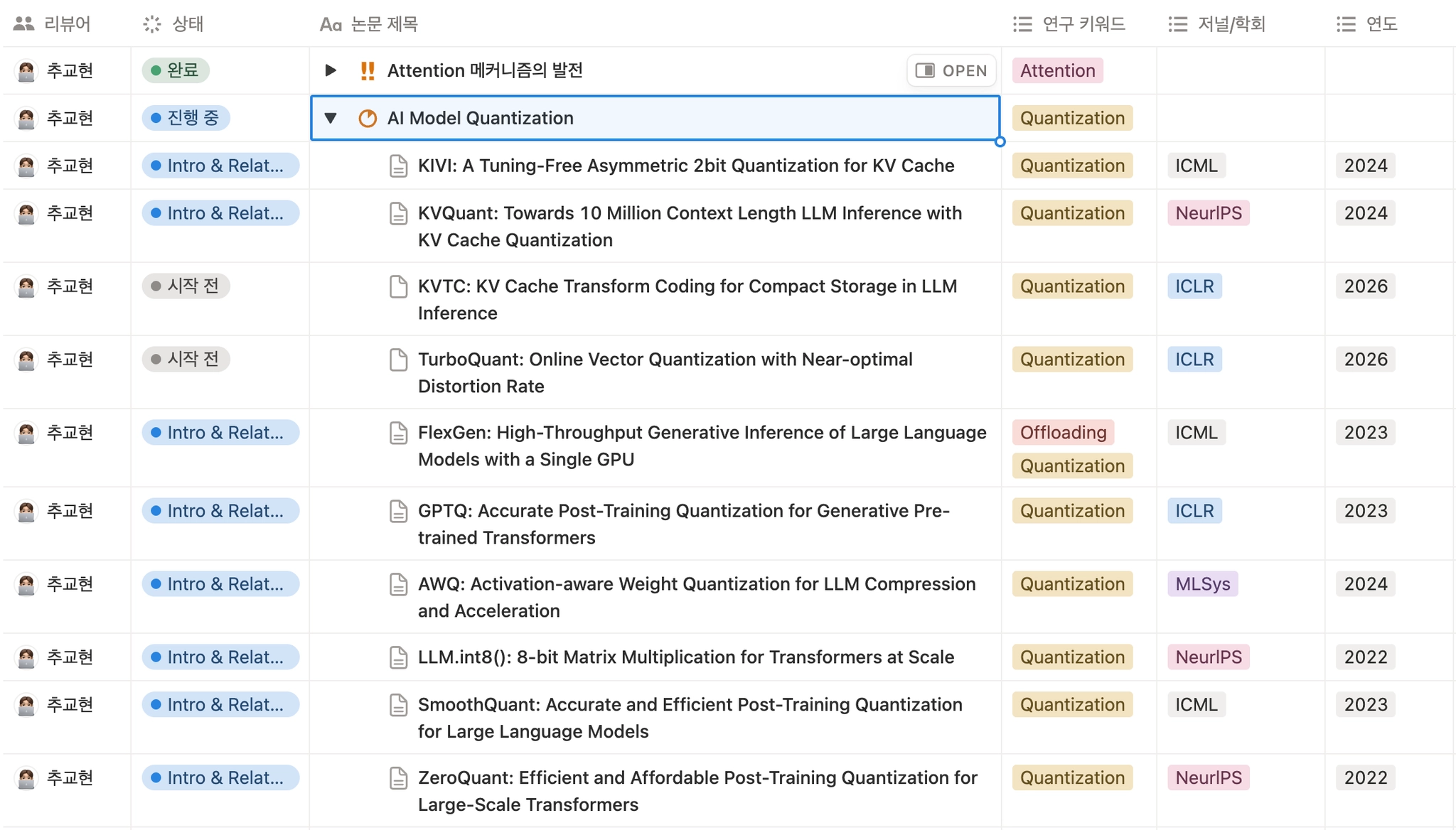

AI 양자화 분야 논문 정리

석사를 시작할 때부터 연구했던 Cloud 시스템 분야(Serverless Computing)에서 On-Device AI 시스템 분야로 연구 방향을 전환했습니다.

연구 방향을 바꾼 이유는 크게 세 가지였습니다.

첫째, 특정 분야의 확실한 전문성보다는 폭넓게 다양한 지식을 쌓는 게 장기적으로 더 도움이 되겠다고 판단했습니다. 교수님께서 남들이 인정하는 특정 분야의 전문성을 갖추려면 적어도 박사과정까지는 가야 한다고 조언해 주셨습니다. 석사과정에서도 물론 깊이를 가질 수는 있지만, 박사과정 진학을 염두에 두지 않은 제 입장에서는 오히려 폭넓게 다양한 지식을 쌓는 편이 장기적으로 더 도움이 되겠다고 판단했습니다.

둘째, 클라우드 인프라뿐만 아니라 LLM의 동작 원리와 GPU/NPU 같은 AI 가속기에 대해서 궁금했고 공부해 보고 싶었습니다. 역시나 재밌는 것 같습니다…

셋째, AI 모델이 장기적으로 엣지 디바이스(모바일, 로봇 등) 위에서 추론되려는 수요가 점점 많아질 것으로 생각합니다. 지연 시간, 프라이버시, 그리고 하드웨어 발전 속도를 고려하면 온-디바이스 AI 방향으로 계속해서 흘러가지 않을까 싶습니다.

연구 방향을 정한 뒤에는 먼저 차근차근 기본기를 쌓아 나갔습니다. “Attention Is All You Need” 논문과 함께 Transformer 아키텍처에 대한 이해도를 높였고, 표준 오픈소스 LLM의 대표격인 Meta의 Llama 모델의 테크니컬 리포트를 읽고 정리했습니다. 이후 오픈소스 LLM Serving 프레임워크인 vLLM과 SGLang을 직접 사용해 보면서 해당 논문들을 정독했습니다. 또한, GPU 아키텍처와 CUDA 프로그래밍을 간단히 공부하며 하드웨어 레이어에 대한 이해도를 높였습니다.

최근에는 본격적으로 KV Cache 양자화(Quantization) 쪽으로 세부 연구 방향을 확정한 뒤, 양자화 쪽 핵심 논문들을 정독하고 있습니다. 최근에 아주 핫했던 구글의 TurboQuant부터 KVTC, LLM.int8(), ZeroQuant, GPTQ, SmoothQuant, FlexGen, AWQ, KIVI, KVQuant까지 총 10편의 양자화 관련 논문을 선정했고, 각 논문의 Introduction과 Related Work를 먼저 훑었습니다. 이를 통해 현재 이 연구 분야에 어떤 문제가 있고, 기존에는 어떤 방식으로 풀어 왔으며, 기존 해결책에는 또 어떤 한계가 있는지, 그리고 각 논문은 그것을 어떤 식으로 풀고자 하는지에 대한 큰 그림을 그릴 수 있었습니다.

4월에는 이 10편을 모두 완독하고, 제 논문 아이디어의 간단한 초안까지 잡아 보는 것이 목표입니다. 흔들리지 않는 기본기부터 차근차근 다지는 것이 정도(正道)라고 생각합니다. 지금의 과정이 지루하고 어렵게 느껴질 수도 있지만, 이 시간이 결국 다음 단계의 단단한 토대가 될 것이라고 생각합니다.

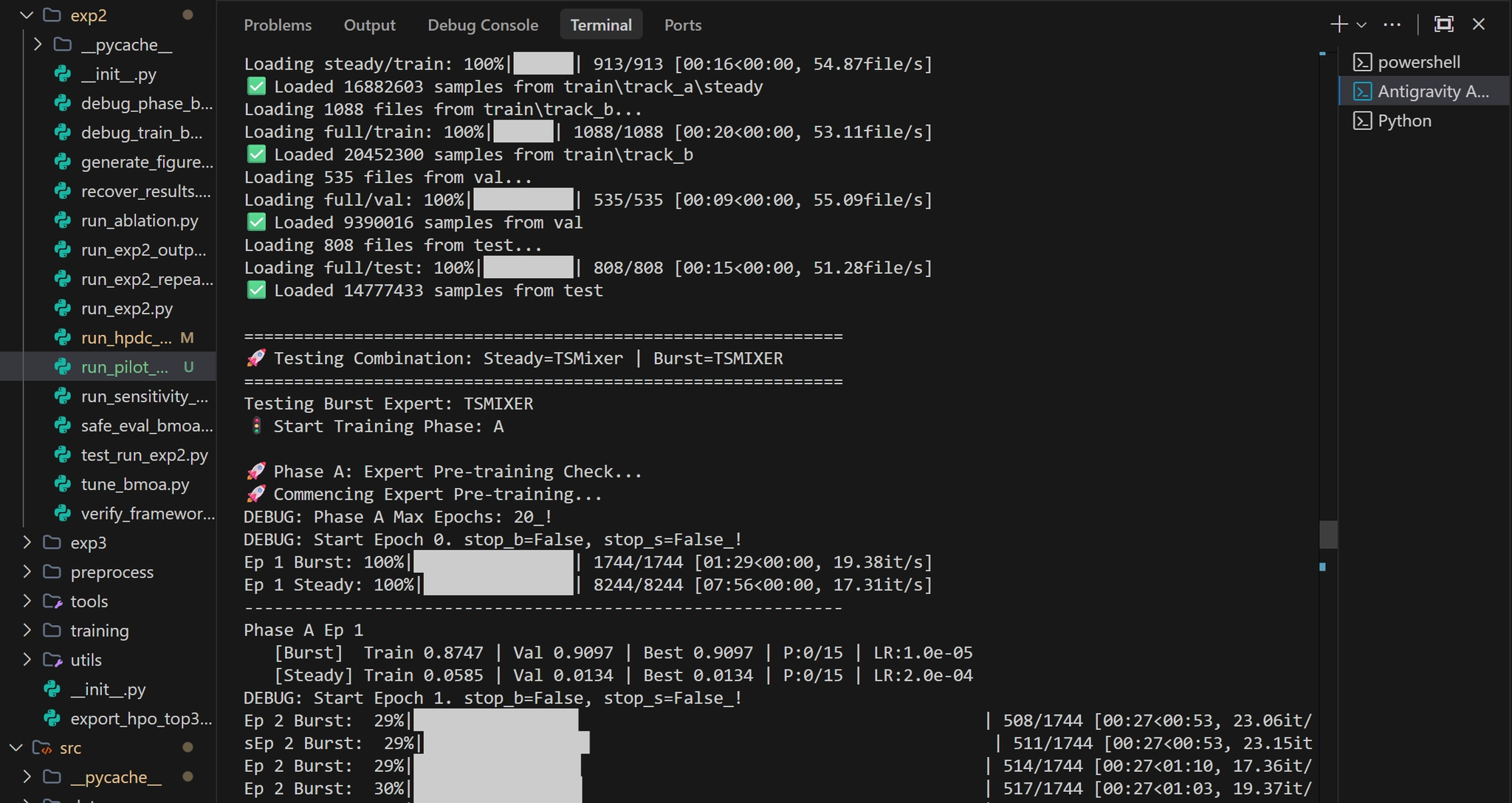

[26.03] B-MoA 논문 Reject, 다시 실험

제가 2월 초에 HPDC 학회에 제출했던 논문인 B-MoA는 서버리스 환경에서 갑작스럽게 트래픽이 몰리는 워크로드(Burst Workload)를 Mixture-of-Experts 기반으로 예측 및 대응하여 콜드 스타트 문제를 완화시키고 오버프로비저닝을 최소화하는 것을 목표로 한 논문입니다.

3월 말에 Reject를 받았고 리뷰 코멘트를 꼼꼼히 분석한 뒤, 부족했던 부분을 보완하기 위해 현재 재실험을 진행하고 있습니다. 결과는 아쉽지만, 첫 1저자 논문을 끝까지 작성해 국제학회에 제출까지 해 봤다는 것 자체에 의미를 두고 있습니다. 그 과정에서 배운 것들을 바탕으로, 지금 진행 중인 On-Device AI 시스템 연구(KV Cache Quantization)에 더 큰 무게를 두고 집중하고자 합니다.

[마무리] 26년 2분기 계획 및 목표

저에게 다음 분기(4~6월)는 어찌 보면 석사과정을 얼마나 아름답게(?) 마무리할 수 있을지를 결정짓는 가장 중요한 시기입니다. 다음 분기에 On-Device AI 시스템 연구에서 구체적인 논문 아이디어를 잡아내고, 구현과 실험을 거쳐 논문 초안까지 작성하는 것이 핵심 목표입니다. 이 흐름이 원활하게 진행되어야 7월부터 시작될 26년 하반기 공채 준비에도 어느 정도 리소스를 쓸 수 있기 때문입니다.

그 외에도 코딩 테스트나 영어 회화 같은 기본기도 계속해서 이어가려 합니다. 그리고 무엇보다 가장 중요한 건강을 지키기 위해서 운동(헬스, 러닝, 축구 등)을 꾸준히 하겠습니다.

긴 글 읽어 주셔서 대단히 감사드립니다. 다들 건강 조심하시고 화이팅입니다

“50대의 추교현이 20대의 추교현에게 감사할 수 있도록 하루하루 최선을 다해 살고 있습니다.”

The End.